SIGGRAPH VR Village(VR山庄)的主席是Denise Qusnel。据她所说这次大会近乎于四分之一的项目都与沉浸式的虚拟现实有关,而这次的大会我们更是可以与这些新型虚拟现实的技术有更多的交互。VR Village的入场费用在150美元到250美元之间,所有的虚拟现实相关的技术都将在这里展示,那么在这次的SIGGRAPH大会中,我们期待见到什么呢?下面我们来看看Denise Qusnel如何解答大家的疑问吧。

今年的VR展会与以往相比有什么不同呢?

Denise Qusnel: 之前的SIGGRAPH大会,我们采用的是VR和AR的普通主题展示,演示和展览都有一个预定的重点领域,特别是在物理空间和概念空间两方面。然而今年,我们将看到VR是多么不可思议的深入到每一个项目当中,现在VR和AR在市场上越来越流行,SIGGRAPH已经几乎找不到与AR和VR技术不相关的项目了。

今年我们正在做一些全新的版块,一个是VR Village 中的Experiences Presentation(体验演讲)版块,其中包括新兴技术、工作室和美术馆体验内容的介绍。一些展示人员将把VR融合到他们的演讲里,让观众们有更直观的体验。体验演讲的话题从Artistic VR Techniques(VR技术的艺术)到游戏“Bound” 创作的解析,带给人们身临其境的体验。

在Artistic VR Techniques中,Oculus公司将会展示艺术家如何利用Quill工具在VR中完成三维插图创作。

游戏 ‘Bound’:Plastic Studio(工作室)为PS4创作的VR游戏场景演示。

我们还有Production for VR(VR的产品)版块,来自Baobab的团队的Eric Darnell 和Maureen Fan将会带领大家走进VR电影《Invasion!》中的情节。

Stephanie Riggs和Blair Erickson将会谈谈沉浸式故事讲述中的人机交互。来自Tangerine Apps公司的Joe Farrell也会带来Jungle Book:Mowgli’s Eyes(丛林之书:毛克利的眼睛)短短8周的制作经验演讲。Magnopus将会展示 ‘The Argos File’系列影片 ,它结合了Nokia OZO摄像系统的视觉效果和游戏引擎机制。

对于对渲染感兴趣的程序员,我们还开设了‘The Art & Science of Immersion’(沉浸式的科学和艺术)版块。其中包括把Google Earth(谷歌地球)带入VR; Oculus的Quill创造工具;Qt 3D(一个渲染器的数据驱动);最后还有一个健康方向的VR展示:Creation of VR for Health and Social Gain(创建虚拟现实对健康和社会利益),这个项目是由Nationwide儿童医院和俄亥俄州立大学带来的(俄亥俄州立大学创作过一个关于儿科疼痛管理的( pediatric pain management)VR应用程序)。另外Walter Greenleaf教授和斯坦福大学的VR研究专家也将谈谈VR技术如何变革医疗领域。

另外与开发相关的版块是VR StoryLab(VR故事实验室),观众能在45分钟的巡回展览中尝试11种不同的VR故事沉浸式体验, 参与者可以参观完“Invasion”展区,接着又跳到“Quill”展区。我们之所以把这个版块叫做Lab是因为我们鼓励参与者在体验完毕后可以做一个简短的调查问卷,这些重要的反馈将会帮助未来SIGGRAPH大会的扩展,也是Computer Animation Festival(计算机动画节)的关键。

在SIGGRAPH大会上,HMD设备将会非常常见,这次大会我们主要采用Google Cardboard和三星Gear VR。Oculus是参展者最常使用的头戴显示器,因为它坚固且易于开发。同样的也有少数HTC Vive,PS4 VR或者Google Tangle为主的项目。我很高兴看到各种不同的科技汇集于SIGGRAPH大会,参展者可以把Google Cardboard带回家,NVDIA也为少数工作站提供了最新的显卡,我们尽可能的用最高帧频来做展示以保证画面质量。

Google Tango项目把现实世界转换为立体像素。

最令Denise Qusnel印象深刻的项目有哪些呢?

Denise Qusnel: 我完全惊异于现在沉浸式虚拟现实项目的细节和见解。关于细节,是指在沉浸式环境中看到的所有东西和听到的任何声音,当然也包括了人机交互的细节设计。

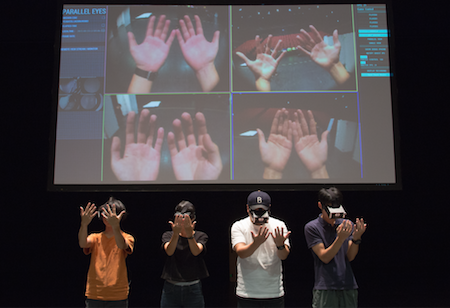

有一个叫“parallel eyes”(平行眼)的项目通过眼部跟踪利用第一人称视角来探索人类的能力和行为。每个用户都可以实时看到其他用户第一人称视角的景象,同一时间最多4人。我们正在建立一个巨大的不受限制的VR环境,这个装置把VR带入了了有形的物理空间,这个全新的技术是由索尼公司、东京大学和山口艺术中心带来的。

parallel eyes实时分享第一人称视角。

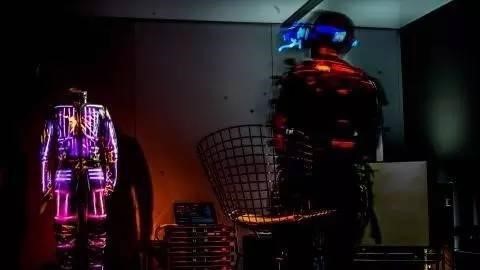

另外我也非常期待看到日本动漫“GHOST IN THE SHELL: THE MOVIE Virtual Reality Diver” 《攻壳机动队: VR剧场版》,这次的新剧场版将会投入VR(虚拟实境)技术,实现360度立体影像,将观赏时的空间呈现感带来前所未有的突破。还有‘Synesthesia Suit’(共感套装)这个项目,参与者可以穿上我们提供的衣服体验PS4的Rez游戏,感觉全身的触觉震动。

GHOST IN THE SHELL VR剧场版动画。

Synesthesia Suit触觉震动套装

VR过去和现在有什么不同呢?

Denise Quesnel: 就像我之前提到的,这些项目在细节和交互方面给我留下了很深的印象。很多项目例如眼部追踪,脑电图、心率监测等很多生物反馈技术都非常成功。这是一个很好的在VR环境中探索生物情感反馈的机会。现在的人们愿意去带着HMD,耳机,麦克风等小装置,那么把一些生物反馈、触觉感应工具加在硬件或者软件上也不是一个太大的负担。VR Village 有一个 “Inner Activity” (内部活动)项目,这个项目把一个叫做Subpac的可穿戴的触觉低音系统和VE环境联系到一起,通过虚拟现实使用低频声音来利用冥想概念制作的一款医疗应用。

来自南加州大学的Inner Activity。

迪士尼将带来一个以叫“IRIDiuM”Interactive Rendered Immersive Deep Media(交互渲染沉浸式深层媒体)的项目,迪士尼研究所根据追踪的用户头部姿势,配置高精细的沉浸实时内容。在第二阶段,来自Interial Measurement Unit(惯性测量单元)的数据可以被用来追踪头部和上半身,肌电图传感器也可侦测到受不活动和抓取动作。它们的real-time solver实时解算器会根据传感器的数据来预估出用户姿态,从来带来更深度的媒体体验。

IRIDiuM:迪士尼提供的“motion parallax within pre-rendered graphics”(预渲染图形中的运动时差)方法。

眼部追踪在HMD中越来越常见了,也有少数人将脑电波传感器加入到HMD设备中,在AR和VR领域,眼追踪已经是一件很简单的事情,但是脑电波数据有时会受到干扰,在实时分析脑电波原始数据方面我们还需要做很多工作。如果VR环境可以根据用户的压力层级、注意力来作出反馈,或者帮助我们提升记忆力和学习,那是一件多么神奇的事情啊!目前在大家看来神经反馈还是一项全新的技术,但正因如此,它在VR领域存在着巨大的潜能。

本文由布格VR翻译完成,转载请注明:布格VR